We zijn blij dat we zijn aangekondigd als winnaar op VivaTech 2021 voor de UNESCO-uitdaging voor gendervooroordelen. Syntho: “bias in = bias out” en we stellen voor om onevenwichtigheden in de inputdata op te lossen door deze te balanceren met intelligente synthetische data. Bij VivaTech hebben we onze gloednieuwe 'databalanceringsfunctie' gedemonstreerd, een van onze nieuwe toegevoegde waarde synthetische datafuncties, waarmee u uw data naar een hoger niveau tilt!

VivaTech is Europa's grootste startup- en tech-evenement dat wordt georganiseerd op 16-19 juni 2021. Dit jaar organiseerde de organisatie een hybride ervaring vanwege COVID, persoonlijk in Parijs en online wereldwijd, die een nog grotere gemeenschap van innovators samenbrengt.

UNESCO is de educatieve, wetenschappelijke en culturele organisatie van de Verenigde Naties. UNESCO komt op voor vrijheid van meningsuiting en toegang tot informatie, als grondrecht en sleutelvoorwaarde voor democratie en ontwikkeling. Als ideeënlaboratorium met digitale innovatie als kern, helpt UNESCO landen beleid en programma's te ontwikkelen die de vrije stroom van ideeën en kennisuitwisseling bevorderen om de uitdagingen van de wereld aan te pakken en duurzame ontwikkeling voor iedereen te garanderen.

De genderbias-uitdaging heeft tot doel de digitale genderkloof te verkleinen door vooroordelen in AI aan het licht te brengen. AI voedt zich met vooringenomen datasets, waardoor de bestaande gendervooroordelen in onze samenlevingen worden versterkt. Er zijn aanwijzingen dat tegen 2022 85% van de AI-projecten door vooringenomenheid onjuiste resultaten zal opleveren als AI als technologie en als sector niet inclusiever en diverser is. Hoe kunnen we ervoor zorgen dat datasets diverser zijn? UNESCO zoekt naar innovatieve oplossingen die tot doel hebben de digitale kloof tussen mannen en vrouwen te verkleinen door vooroordelen in AI aan het licht te brengen.

Het baanbrekende rapport van UNESCO uit 2019 toonde aan dat AI-aangedreven stemassistent-tools zoals Alexa en Siri schadelijke stereotypen in stand hielden en dat seksistisch misbruik gericht op 'gefeminiseerde' technologie zelfs werd verwacht door technologiebedrijven.

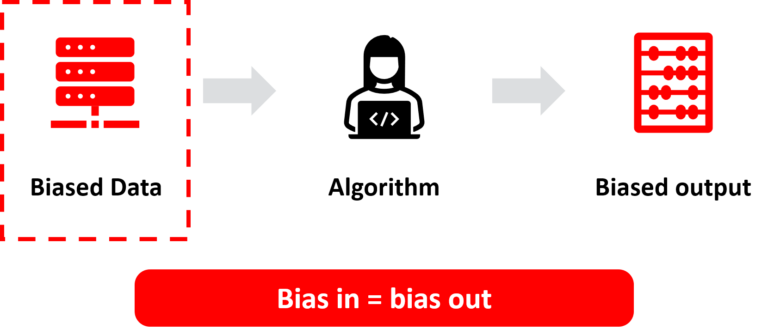

In dit voorbeeld van UNESCO, als er een bepaalde vertekening in de data is, zal dit onterecht vertekening in de uitvoer veroorzaken. Vandaar onze uitspraak: 'bias in = bias out'. En in het gedeelde voorbeeld wisten de ontwikkelaars blijkbaar al van bepaalde onevenwichtigheden en vooroordelen in de data. Dus, hoe dit te overwinnen?

We moeten de dataset opnieuw in evenwicht brengen om uitdagingen op het gebied van databias op te lossen die kunnen leiden tot discriminatie in algoritmen. Hoe werkt onze oplossing. In dit voorbeeld is er een vertekening en onbalans in de data. Waar we 50% mannen en 50% vrouwen verwachten, zien we slechts 33% vrouwen en 66% mannen. We kunnen dit oplossen door extra synthetische vrouwelijke of mannelijke datarecords te genereren om de dataset terug te brengen naar 50% mannen en 50% vrouwen om vooroordelen en onevenwichtigheden in de data die tot discriminatie kunnen leiden, te verminderen. Zo lossen we databias op. We lossen het probleem op bij de wortel. We lossen de uitdaging 'bias in = data bias out' op.

Neem contact op met Syntho en een van onze experts neemt razendsnel contact met je op om de waarde van synthetische data te onderzoeken!