Kami senang diumumkan sebagai pemenang di VivaTech 2021 untuk tantangan bias gender UNESCO. Syntho: "bias in = bias out" dan kami mengusulkan untuk mengatasi ketidakseimbangan dalam input data dengan menyeimbangkannya dengan data sintetik cerdas. Di VivaTech, kami mendemonstrasikan 'fitur penyeimbangan data' baru kami, salah satu nilai tambah baru kami fitur data sintetis, yang membawa data Anda ke level berikutnya!

VivaTech adalah acara startup dan teknologi terbesar di Eropa yang diselenggarakan pada 16-19 Juni 2021. Tahun ini, organisasi tersebut menyelenggarakan pengalaman hybrid karena COVID, secara langsung di Paris dan online di seluruh dunia, yang menyatukan komunitas inovator yang lebih besar.

UNESCO adalah Organisasi Pendidikan, Ilmu Pengetahuan dan Kebudayaan Perserikatan Bangsa-Bangsa. UNESCO membela kebebasan berekspresi dan akses ke informasi, sebagai hak fundamental dan syarat utama bagi demokrasi dan pembangunan. Berfungsi sebagai laboratorium ide dengan inovasi digital di jantungnya, UNESCO membantu negara mengembangkan kebijakan dan program yang mendorong aliran bebas ide dan berbagi pengetahuan untuk mengatasi tantangan dunia dan memastikan pembangunan berkelanjutan untuk semua.

Tantangan bias gender bertujuan untuk mengurangi kesenjangan digital gender dengan mengekspos bias dalam AI. AI memanfaatkan kumpulan data yang bias, memperkuat bias gender yang ada di masyarakat kita. Bukti menunjukkan bahwa pada tahun 2022, 85% proyek AI akan memberikan hasil yang salah karena bias jika AI sebagai teknologi dan sebagai sektor tidak lebih inklusif dan beragam. Bagaimana kita bisa memastikan kumpulan data lebih beragam? UNESCO sedang mencari solusi inovatif yang bertujuan untuk mengurangi kesenjangan digital gender dengan mengekspos bias dalam AI.

Laporan mani UNESCO dari 2019 menunjukkan bahwa alat asisten suara bertenaga AI seperti Alexa dan Siri mengabadikan stereotip berbahaya dan pelecehan seksis yang diarahkan pada teknologi 'feminin' bahkan diantisipasi oleh perusahaan teknologi.

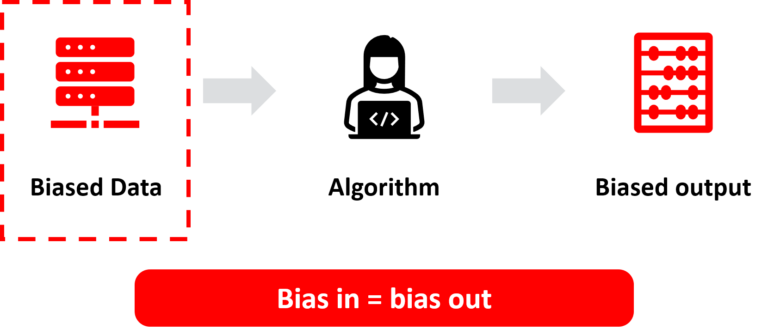

Dalam contoh ini dari UNESCO, Jika ada bias tertentu dalam data, itu akan menyebabkan bias dalam output. Oleh karena itu, pernyataan kami: 'bias masuk = bias keluar'. Dan dalam contoh yang dibagikan, pengembang tampaknya sudah mengetahui tentang ketidakseimbangan dan bias tertentu dalam data. Nah, bagaimana cara mengatasi hal tersebut?

Kami harus menyeimbangkan kembali kumpulan data untuk menyelesaikan tantangan bias data yang dapat menyebabkan diskriminasi dalam algoritme. Bagaimana solusi kami bekerja. Dalam contoh ini, ada bias dan ketidakseimbangan dalam data. Dimana kita mengharapkan 50% laki-laki dan 50% perempuan, kita hanya melihat 33% perempuan dan 66% laki-laki. Kami dapat mengatasi ini dengan membuat catatan data wanita atau pria sintetis ekstra untuk menyeimbangkan set data kembali ke 50% pria dan 50% wanita untuk mengurangi bias dan ketidakseimbangan dalam data yang dapat mengakibatkan diskriminasi. Inilah cara kami mengatasi bias data. Kami memecahkan masalah dengan akarnya. Kami memecahkan tantangan 'bias in = data bias out'.

Hubungi Syntho dan salah satu pakar kami akan menghubungi Anda secepat cahaya untuk menjelajahi nilai data sintetis!