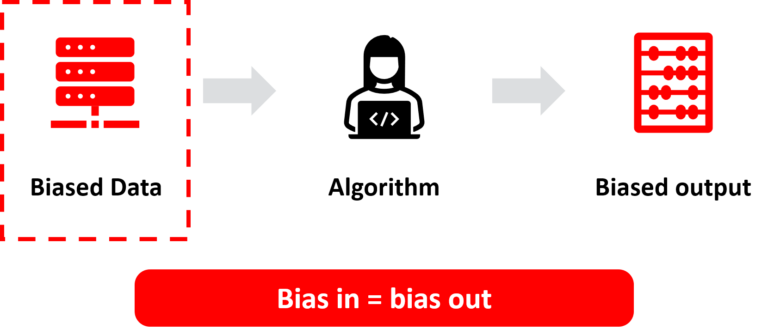

Wy binne bliid dat wy as winner oankundige wurde by VivaTech 2021 foar UNESCO's gender bias-útdaging. Syntho: "bias in = bias out" en wy stelle foar om ûnbalâns yn 'e ynfiergegevens op te lossen troch it te balansearjen mei yntelliginte syntetyske gegevens. By VivaTech demonstrearren wy ús gloednije 'databalânsfunksje', ien fan ús nije tafoeging fan wearde syntetyske gegevens funksjes, dat bringt jo gegevens nei it folgjende nivo!

VivaTech is it grutste start- en tech-evenemint fan Jeropa dat wurdt host op 16-19 juni 2021. Dit jier organisearre de organisaasje in hybride ûnderfining fanwegen COVID, persoanlik yn Parys en online wrâldwiid, dat in noch gruttere mienskip fan fernijers byinoar bringt.

UNESCO is de Organisaasje foar Underwiis, Wittenskip en Kultuer fan 'e Feriene Naasjes. UNESCO stiet foar frijheid fan mieningsutering en tagong ta ynformaasje, as in fûneminteel rjocht en in wichtige betingst foar demokrasy en ûntwikkeling. Tsjinnet as in laboratoarium fan ideeën mei digitale ynnovaasje yn it hert, helpt UNESCO lannen belied en programma's te ûntwikkeljen dy't de frije stream fan ideeën en it dielen fan kennis befoarderje om de útdagings fan 'e wrâld oan te pakken en duorsume ûntwikkeling foar elkenien te garandearjen.

De útdaging foar geslachtsbias hat as doel de digitale skieding fan geslacht te ferminderjen troch foaroardielen yn AI te eksposearjen. AI feedt op foaroardiele datasets, fersterket de besteande geslachtsbias yn ús mienskippen. Bewiis lit sjen dat yn 2022 85% fan AI -projekten ferkearde útkomsten sille leverje fanwegen foaroardielen as AI as technology en as sektor net mear inklusyf en ferskaat is. Hoe kinne wy derfoar soargje dat datasets mear ferskaat binne? UNESCO siket nei ynnovative oplossingen dy't as doel hawwe de geslachtsdifferinsje fan geslacht te ferminderjen troch foaroardielen yn AI te eksposearjen.

It seminêr rapport fan UNESCO út 2019 die bliken dat AI-oandreaune stimassistinte-ark lykas Alexa en Siri skealike stereotypen bestudearren en seksistysk misbrûk rjochte op 'feminisearre' technology sels waard ferwachte troch techbedriuwen.

Yn dit foarbyld fan UNESCO, As d'r in bepaalde foaroardiel is yn 'e gegevens, sil it ûnferjitlik foaroardielen feroarsaakje yn' e útfier. Dêrom is ús ferklearring: 'bias in = bias out'. En yn it dielde foarbyld wisten de ûntwikkelders blykber al oer bepaalde ûnbalâns en foaroardielen yn 'e gegevens. Dat, hoe dit te oerwinnen?

Wy moatte de dataset opnij balansearje om útdagingen foar gegevensbias op te lossen dy't kinne liede ta diskriminaasje yn algoritmen. Hoe wurket ús oplossing. Yn dit foarbyld is d'r in foaroardiel en ûnbalâns yn 'e gegevens. Wêr't wy 50% mantsjes en 50% wyfkes ferwachtsje, sjogge wy mar 33% wyfkes en 66% mantsjes. Wy kinne dit oplosse troch it generearjen fan ekstra syntetyske froulike as manlike gegevensrekords om de dataset werom te balânsjen nei 50% manlju en 50% froulju om foaroardielen en ûnbalâns yn 'e gegevens te ferminderjen dy't kin resultearje yn diskriminaasje. Dit is hoe't wy gegevensfoaroardielen oplosse. Wy lossen it probleem op mei syn woartels. Wy lossen de 'bias in = data bias out' útdaging op.

Nim kontakt op mei Syntho en ien fan ús saakkundigen sil yn kontakt komme mei jo op 'e snelheid fan ljocht om de wearde fan syntetyske gegevens te ferkennen!