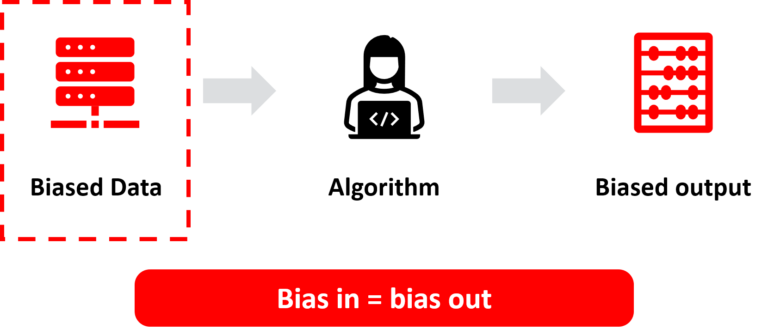

خوشحالیم که در VivaTech 2021 به عنوان برنده چالش تعصب جنسیتی یونسکو اعلام شدیم. Syntho: "bias in = bias out" و ما پیشنهاد می کنیم که عدم تعادل در داده های ورودی را با متعادل کردن آن با داده های مصنوعی هوشمند حل کنیم. در VivaTech، "ویژگی متعادل سازی داده" جدید خود را به نمایش گذاشتیم که یکی از ارزش افزوده های جدید ماست ویژگی های داده های مصنوعی، که داده های شما را به سطح بعدی می برد!

VivaTech بزرگترین رویداد استارتاپی و فناوری اروپا است که در تاریخ 16 تا 19 ژوئن 2021 برگزار شد. امسال ، این سازمان میزبان یک تجربه ترکیبی به دلیل COVID ، به صورت حضوری در پاریس و آنلاین در سراسر جهان بود ، که جامعه بزرگتری از نوآوران را گرد هم می آورد.

یونسکو سازمان آموزشی ، علمی و فرهنگی ملل متحد است. یونسکو از آزادی بیان و دسترسی به اطلاعات به عنوان یک حق اساسی و شرط کلیدی برای دموکراسی و توسعه دفاع می کند. یونسکو که به عنوان آزمایشگاه ایده ها با نوآوری های دیجیتالی در قلب خود فعالیت می کند ، به کشورها کمک می کند تا سیاست ها و برنامه هایی را توسعه دهند که جریان آزاد ایده ها و اشتراک دانش را برای مقابله با چالش های جهان و توسعه پایدار برای همه تضمین کند.

هدف چالش سوگیری جنسیتی کاهش شکاف دیجیتالی جنسیتی با افشای سوگیری در هوش مصنوعی است. هوش مصنوعی از مجموعه داده های مغرضانه تغذیه می کند و تعصب جنسیتی موجود در جوامع ما را تقویت می کند. شواهد نشان می دهد که تا سال 2022 ، 85٪ از پروژه های هوش مصنوعی نتایج نادرستی را به دلیل جانبداری به دنبال خواهد داشت اگر هوش مصنوعی به عنوان یک فناوری و به عنوان یک بخش فراگیر و متنوع نباشد. چگونه می توانیم مطمئن شویم که مجموعه داده ها تنوع بیشتری دارند؟ یونسکو به دنبال راه حل های خلاقانه ای است که هدف آن کاهش شکاف دیجیتالی جنسیتی با افشای سوگیری در هوش مصنوعی است.

گزارش نهایی یونسکو از سال 2019 نشان داد که ابزارهای دستیار صوتی مجهز به هوش مصنوعی مانند الکسا و سیری کلیشه های مضر را تداوم بخشیده و حتی سوءاستفاده جنسیتی علیه فناوری "زنانه" توسط شرکت های فناوری پیش بینی شده است.

در این مثال از یونسکو ، اگر سوگیری خاصی در داده ها وجود داشته باشد ، بی جهت باعث ایجاد تعصب در خروجی می شود. از این رو ، بیانیه ما: 'تعصب در = تعصب خارج'. و در مثال مشترک ، ظاهراً توسعه دهندگان از عدم تعادل و سوگیری های خاصی در داده ها مطلع بوده اند. بنابراین ، چگونه می توان بر این غلبه کرد؟

ما باید مجموعه داده ها را مجدداً متعادل کنیم تا چالش های سوگیری داده ها را که می تواند منجر به تبعیض در الگوریتم ها شود ، حل کنیم. راه حل ما چگونه کار می کند. در این مثال ، سوگیری و عدم تعادل در داده ها وجود دارد. جایی که انتظار داریم 50 درصد مرد و 50 درصد زن باشد ، تنها 33 درصد زن و 66 درصد مرد می بینیم. ما می توانیم این مسئله را با ایجاد سوابق داده مصنوعی زنانه یا مردانه حل کنیم تا مجموعه داده ها به 50٪ مردان و 50٪ زنان تعادل داده شود تا تعصبات و عدم تعادل در داده ها کاهش یابد که می تواند منجر به تبعیض شود. به این ترتیب ما سوگیری های داده را حل می کنیم. ما مشکل را ریشه ای حل می کنیم. ما چالش "bias in = data bias out" را حل می کنیم.

با سینتو تماس بگیرید و یکی از کارشناسان ما با سرعت نور با شما تماس می گیرد تا ارزش داده های مصنوعی را کشف کند!