Ni ĝojas esti anoncitaj kiel gajnintoj ĉe VivaTech 2021 por la defio pri seksa biaso de Unesko. Syntho: "bias in = bias out" kaj ni proponas solvi malekvilibrojn en la enigdatenoj balancante ĝin kun inteligentaj sintezaj datumoj. Ĉe VivaTech, ni montris nian tutnovan 'datuman ekvilibran funkcion', unu el niaj novaj valor-aldonado sintezaj datumoj trajtoj, tio portas viajn datumojn al la sekva nivelo!

VivaTech estas la plej granda noventreprena kaj te eventnika evento de Eŭropo aranĝita de la 16a ĝis la 19a de junio 2021. Ĉi-jare la organizo gastigis hibridan sperton pro COVID, persone en Parizo kaj interrete tra la mondo, kiu kunigas eĉ pli grandan komunumon de novigantoj.

Unesko estas la Unuiĝintaj Nacioj por Edukado, Scienco kaj Kulturo. Unesko defendas liberecon de esprimo kaj aliro al informoj, kiel fundamenta rajto kaj ŝlosila kondiĉo por demokratio kaj disvolviĝo. Funkciante kiel laboratorio de ideoj kun cifereca novigado en la koro, Unesko helpas landojn disvolvi politikojn kaj programojn, kiuj favoras la liberan fluon de ideoj kaj kono de konoj por trakti la mondajn defiojn kaj certigi daŭrigeblan disvolviĝon por ĉiuj.

La defio pri seksa antaŭjuĝo celas redukti la seksan ciferecan disiĝon per elmontrado de antaŭjuĝo en AI. AI nutras sin de partiaj datumaroj, plifortigante la ekzistantan seksan antaŭjuĝon en niaj socioj. Indico montras, ke antaŭ 2022, 85% de AI-projektoj liveros erarajn rezultojn pro antaŭjuĝo, se AI kiel teknologio kaj kiel sektoro ne estos pli inkluziva kaj diversa. Kiel ni povas certigi, ke datumaroj estas pli diversaj? Unesko serĉas novigajn solvojn, kiuj celas redukti la seksan ciferecan breĉon per elmontrado de antaŭjuĝo en AI.

La ĉefa raporto de Unesko de 2019 montris, ke iloj kun helpo de voĉa asistanto, kiel Alexa kaj Siri, eternigas malutilajn stereotipojn kaj seksisma misuzo direktita al "feminigita" teknologio eĉ estis antaŭvidita de te companiesnikaj kompanioj.

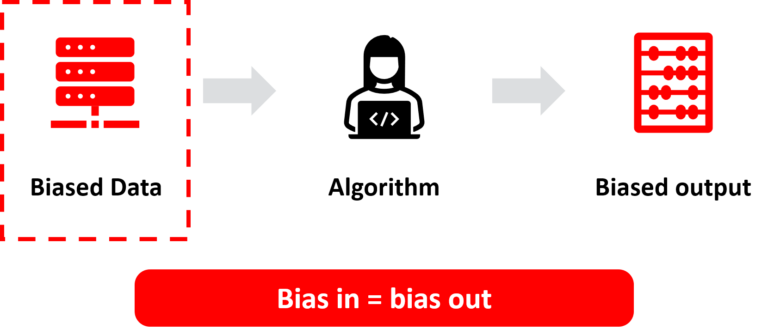

En ĉi tiu ekzemplo de Unesko, Se estas certa antaŭjuĝo en la datumoj, ĝi senmerite kaŭzos antaŭjuĝojn en la eligo. Sekve nia aserto: 'bias in = bias out'. Kaj en la komuna ekzemplo, la programistoj ŝajne jam sciis pri iuj malekvilibroj kaj antaŭjuĝoj en la datumoj. Do, kiel superi ĉi tion?

Ni devas reekvilibrigi la datumaron por solvi datumajn antaŭjuĝajn defiojn, kiuj povus konduki al diskriminacio en algoritmoj. Kiel funkcias nia solvo. En ĉi tiu ekzemplo, estas antaŭjuĝo kaj malekvilibro en la datumoj. Kie ni atendas 50% virojn kaj 50% inojn, ni vidas nur 33% inojn kaj 66% virojn. Ni povas solvi ĉi tion generante ekstrajn sintezajn inajn aŭ virajn datumajn registrojn por ekvilibrigi la datumaron al 50% de viroj kaj 50% de virinoj por mildigi antaŭjuĝojn kaj malekvilibrojn en la datumoj, kiuj povus rezultigi diskriminacion. Tiel ni solvas datumajn antaŭjuĝojn. Ni solvas la problemon per ĝiaj radikoj. Ni solvas la defion 'bias in = data bias out'.

Kontaktu Syntho kaj unu el niaj spertuloj kontaktos vin kun la lumrapideco por esplori la valoron de sintezaj datumoj!