Estem encantats d'haver estat anunciats com a guanyadors a VivaTech 2021 del repte de la UNESCO sobre la discriminació de gènere. Syntho: "bias in = bias out" i proposem resoldre els desequilibris en les dades d'entrada equilibrant-les amb dades sintètiques intel·ligents. A VivaTech, vam demostrar la nostra nova "funció d'equilibri de dades", un dels nostres nous valors afegits característiques de dades sintètiques, això porta les vostres dades al següent nivell!

VivaTech és l’esdeveniment d’inici i tecnologia més gran d’Europa organitzat els dies 16 i 19 de juny de 2021. Aquest any, l’organització va acollir una experiència híbrida deguda a COVID, presencialment a París i en línia a tot el món, que reuneix una comunitat d’innovadors encara més gran.

La UNESCO és l'Organització de les Nacions Unides per a l'Educació, la Ciència i la Cultura. La UNESCO defensa la llibertat d’expressió i l’accés a la informació, com a dret fonamental i condició clau per a la democràcia i el desenvolupament. Servint de laboratori d’idees amb la innovació digital al centre, la UNESCO ajuda els països a desenvolupar polítiques i programes que afavoreixin el lliure flux d’idees i l’intercanvi de coneixement per afrontar els reptes del món i garantir un desenvolupament sostenible per a tothom.

El desafiament de biaix de gènere té com a objectiu reduir la bretxa digital de gènere mitjançant l'exposició de biaixos en IA. La IA s’alimenta de conjunts de dades esbiaixats, amplificant el biaix de gènere existent a les nostres societats. Les evidències mostren que el 2022, el 85% dels projectes d’IA produiran resultats erronis a causa del biaix si la IA com a tecnologia i com a sector no és més inclusiva i diversa. Com podem assegurar-nos que els conjunts de dades siguin més diversos? La UNESCO busca solucions innovadores que tinguin com a objectiu reduir la bretxa digital de gènere exposant biaixos en IA.

L’informe seminal de la UNESCO del 2019 va mostrar que eines d’assistent de veu impulsades per IA, com Alexa i Siri, perpetuaven estereotips nocius i fins i tot les empreses tecnològiques van preveure l’abús masclista dirigit a la tecnologia “feminitzada”.

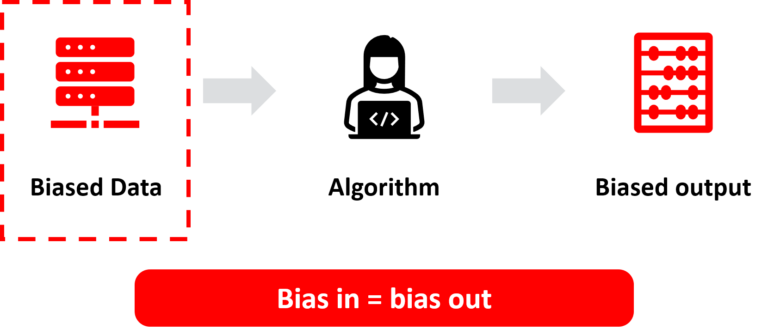

En aquest exemple de la UNESCO, si hi ha un cert biaix a les dades, causarà biaixos sense sortida a la sortida. Per tant, la nostra afirmació: "bias in = bias out". I en l'exemple compartit, aparentment els desenvolupadors ja coneixien certs desequilibris i biaixos en les dades. Llavors, com superar-ho?

Hem de reequilibrar el conjunt de dades per resoldre els desafiaments de biaix de dades que podrien conduir a la discriminació en algorismes. Com funciona la nostra solució. En aquest exemple, hi ha un biaix i un desequilibri en les dades. On esperem un 50% d’homes i un 50% de dones, només veiem un 33% de dones i un 66% d’homes. Podem solucionar-ho generant registres de dades sintètics femenins o masculins addicionals per equilibrar el conjunt de dades al 50% d’homes i un 50% de dones per mitigar els biaixos i els desequilibris de les dades que podrien resultar en discriminació. Així resolem els biaixos de dades. Resolem el problema per les seves arrels. Resolem el desafiament "bias in = data bias out".

Poseu-vos en contacte amb Syntho i un dels nostres experts es posarà en contacte amb vostè a la velocitat de la llum per explorar el valor de les dades sintètiques.