Kita seneng diumumake minangka pemenang ing VivaTech 2021 kanggo tantangan bias gender UNESCO. Syntho: "bias in = bias metu" lan kita ngusulake kanggo ngatasi imbalances ing data input kanthi ngimbangi karo data sintetik cerdas. Ing VivaTech, kita nduduhake 'fitur imbangan data' anyar, salah sawijining nilai tambah anyar fitur data sintetik, sing njupuk data menyang tingkat sabanjuré!

VivaTech minangka acara startup lan teknologi paling gedhe ing Eropa sing dianakake ing 16-19 Juni 2021. Taun iki, organisasi kasebut dadi tuan rumah pengalaman hibrida amarga COVID, ing Paris lan online ing saindenging jagad, sing nggabungake komunitas para inovator sing luwih gedhe.

UNESCO minangka Organisasi Pendidikan, Ilmiah lan Budaya PBB. UNESCO nyedhiyakake kebebasan ekspresi lan akses menyang informasi, minangka hak dhasar lan kondhisi utama kanggo demokrasi lan pembangunan. Dadi laboratorium ide kanthi inovasi digital, UNESCO nulungi negara-negara nggawe kabijakan lan program sing nyengkuyung aliran ide lan nuduhake ilmu gratis kanggo ngatasi tantangan ing jagad lan njamin pembangunan berkelanjutan kanggo kabeh wong.

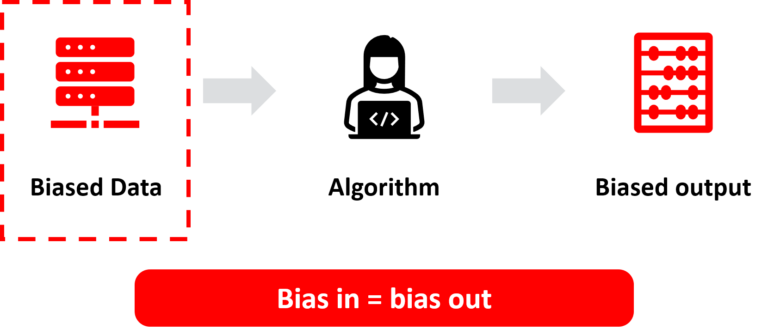

Tantangan bias gender tujuane nyuda pamisahan digital gender kanthi mbabarake bias ing AI. AI menehi umpan data sing bias, nambah bias gender sing ana ing masarakat. Bukti nuduhake manawa ing taun 2022, 85% proyek AI bakal ngasilake asil sing salah amarga bias yen AI minangka teknologi lan minangka sektor kasebut ora kalebu lan macem-macem. Kepiye carane bisa nggawe data kaya luwih macem-macem? UNESCO nggoleki solusi inovatif sing tujuane nyuda pamisahan digital gender kanthi mbabarake bias ing AI.

Laporan seminal UNESCO wiwit taun 2019 nuduhake manawa alat asisten swara nganggo AI kaya Alexa lan Siri tetep nindakake stereotip sing mbebayani lan pelecehan seksis sing dituju ing teknologi 'feminisasi' malah diantisipasi karo perusahaan teknologi.

Ing conto iki saka UNESCO, Yen ana bias tartamtu ing data, kasebut kanthi sengaja bakal nyebabake bias output. Mula, pratelan kita: 'bias in = bias out'. Lan ing conto sing dituduhake, para pangembang rupane wis ngerti babagan ketidakseimbangan lan bias tartamtu ing data. Dadi, carane ngatasi iki?

Kita kudu ngimbangi maneh data kanggo ngatasi tantangan bias data sing bisa nyebabake diskriminasi ing algoritma. Kepiye cara solusi kita bisa digunakake. Ing conto iki, ana bias lan ora seimbang data. Ngarep-arep 50% pria lan 50% wanita, mung 33% wanita lan 66% lanang mung ana. Kita bisa ngrampungake kanthi ngasilake data data wanita utawa pria sintetis ekstra kanggo ngimbangi set data maneh nganti 50% pria lan 50% wanita kanggo nyuda bias lan ketidakseimbangan ing data sing bisa nyebabake diskriminasi. Mangkene carane ngrampungake bias data. Kita ngatasi masalah kanthi oyot. Kita ngatasi tantangan 'bias in = data bias out'.

Hubungi Syntho lan salah sawijining pakar kita bakal sesambungan karo sampeyan kanthi cepet kanggo njelajah nilai data sintetik!