Semu felici di esse annunziatu cum'è vincitore à VivaTech 2021 per a sfida di preghjudiziu di genere di l'UNESCO. Syntho: "bias in = bias out" è prupunemu di risolve i squilibri in i dati di input equilibrendu cù dati sintetici intelligenti. In VivaTech, avemu dimustratu a nostra nova "funzione di bilanciamentu di dati", unu di i nostri novi valori chì aghjunghjenu caratteristiche di dati sintetici, chì porta i vostri dati à u prossimu livellu!

VivaTech hè u più grande avvenimentu di startup è tecnulugia in Europa accoltu da u 16 à u 19 di ghjugnu di u 2021. Quist'annu, l'urganizazione hà accoltu una sperienza ibrida per via di COVID, in persona in Parigi è in ligna in u mondu sanu, chì adunisce una cumunità ancu più grande d'innovatori.

L'UNESCO hè l'Organizazione Naziunale per l'Educazione, a Scienza è a Cultura. L'UNESCO difende a libertà di spressione è l'accessu à l'infurmazione, cum'è un dirittu fundamentale è una cundizione chjave per a demucrazia è u sviluppu. Servendu da laboratorio di idee cun innovazione digitale in u so core, l'UNESCO aiuta i paesi à sviluppà politiche è prugrammi chì favurizanu u flussu liberu di idee è di spartera di e cunniscenze per affrontà e sfide di u mondu è assicurà un sviluppu durevule per tutti.

A sfida di pregiudiziu di sessu hà per scopu di riduce a frattura digitale di genere espunendu pregiudiziu in AI. AI si nutrisce di gruppi di dati pregiudiziali, amplificendu u preghjudiziu di genere esistente in e nostre sucietà. E prove mostranu chì da 2022, l'85% di i prughjetti AI darà risultati erronii per via di pregiudiziu se AI cum'è tecnulugia è cum'è settore ùn hè micca più inclusivu è diversu. Cumu pudemu assicurà chì i gruppi di dati sò più diversi? L'UNESCO cerca soluzioni innovative chì anu per scopu di riduce a frattura digitale di genere espunendu bias in AI.

U rapportu seminale di l'UNESCO di u 2019 hà mostratu chì l'aiutori di assistente vocale alimentati da AI, cume Alexa è Siri, perpetuavanu stereotipi dannosi è l'abusu sessistu direttu à a tecnulugia "feminizzata" era ancu anticipatu da e cumpagnie di tecnulugia.

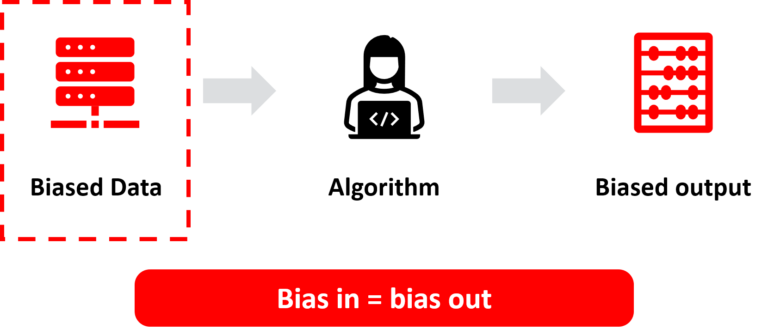

In questu esempiu da l'UNESCO, S'ellu ci hè un certu preghjudiziu in i dati, pruvucarà senza merite pregiudizi in u risultatu. Dunque, a nostra dichjarazione: 'bias in = bias out'. È in l'esempiu cumunu, i sviluppatori apparentemente sapevanu già di certi squilibri è pregiudizi in i dati. Allora, cumu per superà questu?

Avemu da riequilibrà u set di dati per risolve e sfide di pregiudiziu di i dati chì puderebbenu purtà à discriminazione in l'algoritmi. Cumu funziona a nostra soluzione. In questu esempiu, ci hè un preghjudiziu è un sbilanciamentu in i dati. Induve aspettemu 50% masci è 50% femine, vedemu solu 33% femine è 66% masci. Pudemu risolve questu generendu registri di dati sintetici femminili o maschili in più per equilibrà u dataset torna à 50% masci è 50% femine per mitigà pregiudizii è squilibri in i dati chì puderebbenu esse discriminatori. Hè cusì chì risolvemu i pregiudizii di dati. Risolvemu u prublema cù e so radiche. Risolvemu a sfida 'preghjudiziu in = preghjudiziu di dati'.

Cuntattate Syntho è unu di i nostri esperti entrerà in cuntattu cun voi à a velocità di a luce per esplorà u valore di i dati sintetici!