Indovina quale? 5 esempii perchè sguassà i nomi ùn hè micca una opzione

Una introduzione à Guess Who

Induvina Quale? Ancu sì sò sicuru chì a maggior parte di voi cunnoscite stu ghjocu da i tempi, eccu un breve riassuntu. U scopu di u ghjocu: scopre u nome di u persunagiu di cartoni animati selezziunatu da u vostru avversariu dumandendu dumande "iè" è "nò", cum'è "a persona porta un cappellu?" o 'a persona porta i bichjeri'? I ghjucatori eliminanu i candidati basati nantu à a risposta di l'avversariu è amparanu attributi chì si riferenu à u caratteru misteriu di u so avversariu. U primu ghjucadore chì capisce u caratteru misteriu di l'altru ghjucatore vince u ghjocu.

L'avete capita. Duvete identificà l'individuu fora di un set di dati avendu solu accessu à l'attributi currispundenti. In fatti, vedemu regularmente stu cuncettu di Guess Who applicatu in pratica, ma poi impiegatu nantu à set di dati furmatu cù righe è colonne chì cuntenenu attributi di persone reali. A principale differenza quandu si lavora cù i dati hè chì e persone tendenu à sottovalutà a facilità cù a quale l'individui veri ponu esse smascherati avendu accessu solu à pochi attributi.

Cum'è u ghjocu Guess Who illustra, qualcunu pò identificà l'individui avendu accessu solu à pochi attributi. Serve cum'è un esempiu simplice di perchè eliminà solu 'nomi' (o altri identificatori diretti) da u vostru dataset ùn riesce micca cum'è una tecnica d'anonimizazione. In questu blog, furnemu quattru casi pratichi per informarvi nantu à i risichi per a privacy associati à a rimozione di colonne cum'è mezu di anonimizazione di i dati.

2) Attacchi di ligami: u vostru dataset ligatu à altre fonti di dati (publici)

U risicu di un attaccu di ligame hè u mutivu più impurtante perchè solu l'eliminazione di i nomi ùn funziona (più) cum'è metudu per l'anonimizazione. Cù un attaccu di ligame, l'attaccante combina i dati originali cù altre fonti di dati accessibili per identificà univocamente un individuu è amparà (spessu sensibile) informazioni nantu à sta persona.

Chjave quì hè a dispunibilità di altre risorse di dati chì sò prisenti avà, o ponu diventà presenti in u futuru. Pensate à voi stessu. Quantu di i vostri dati persunali si pò truvà nant'à Facebook, Instagram o LinkedIn chì puderebbenu esse abusati per un attaccu di ligame?

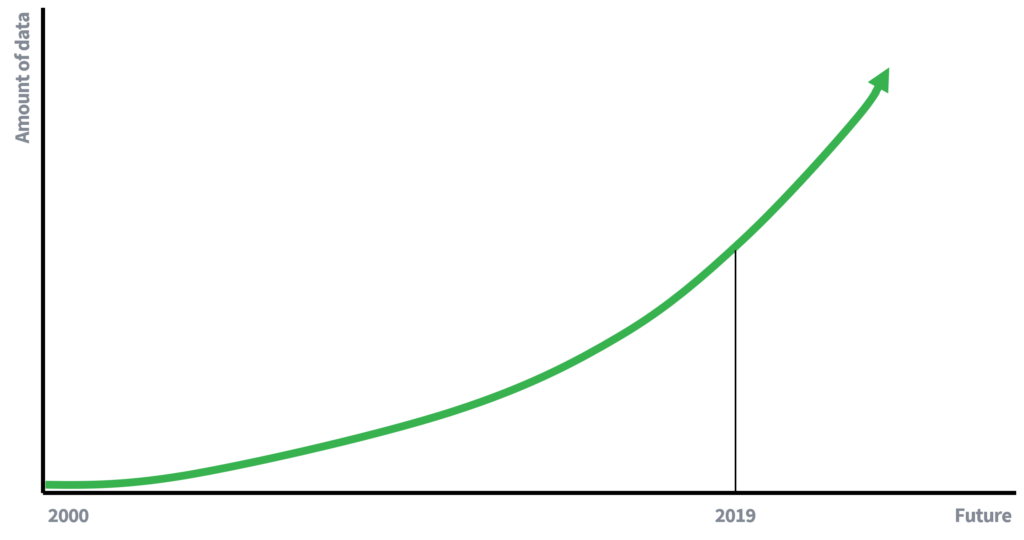

In i primi tempi, a dispunibilità di dati era assai più limitata, ciò chì spiega in parte perchè a rimozione di i nomi era sufficiente per preservà a privacy di l'individui. Dati menu dispunibili significanu menu opportunità per ligà i dati. Tuttavia, simu avà (attivi) participanti à un'ecunumia guidata da i dati, induve a quantità di dati cresce à un ritmu esponenziale. Più dati, è migliurà a tecnulugia per raccoglie dati portanu à un potenziale aumentatu per attacchi di ligami. Chì scriveria in 10 anni circa u risicu di un attaccu di ligame?

Illustrazione 1

Dati crescenti in modu esponenziale hè un fattu

Casu studiu

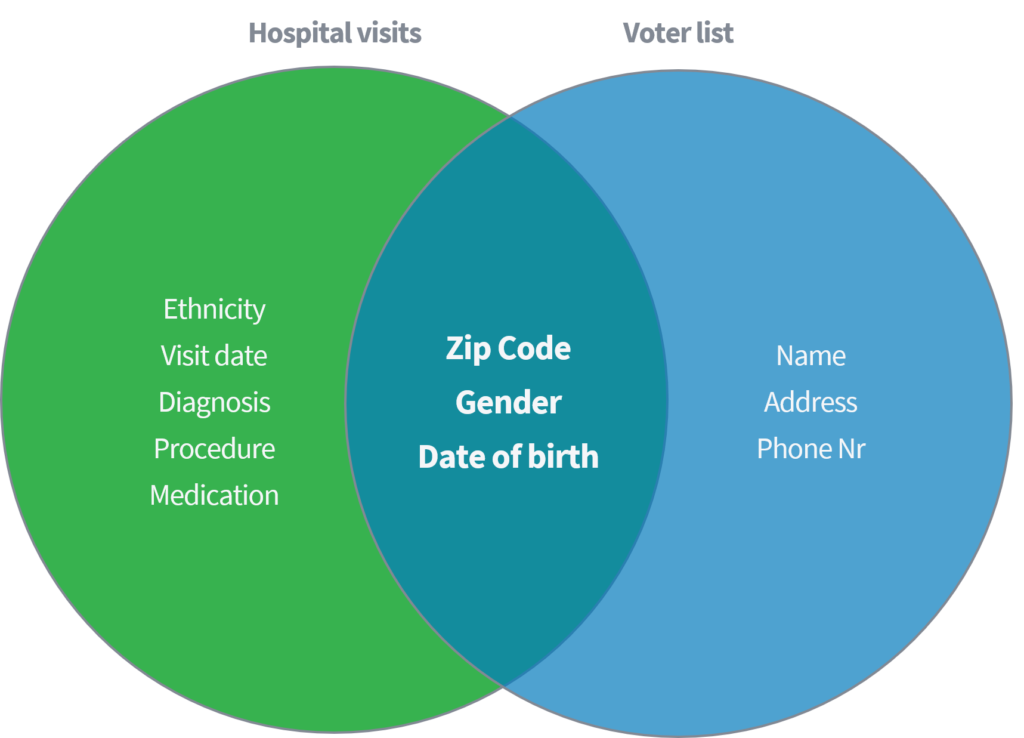

Sweeney (2002) hà dimustratu in un documentu accademicu cumu hè stata capace d'identificà è recuperà dati medichi sensibili da l'individui basatu annantu à u ligame di un set di dati dispunibili publicu di "visite in ospedale" à u registratore di votu dispunibile publicamente in i Stati Uniti. Entrambi i set di dati induve si supponeva esse anonimizzati currettamente attraversu a cancellazione di nomi è altri identificatori diretti.

Illustrazione 2

Attaccu di ligame in pratica

Basatu solu nantu à i trè parametri (1) Codice Postale, (2) Genere è (3) Data di Nascita, hà mostratu chì u 87% di tutta a pupulazione di i Stati Uniti puderia esse riidentificata assucendu attributi sopra menzionati da entrambi i set di dati. Sweeney hà ripetutu u so travagliu cù avè "paese" cum'è alternativa à u "Codice Postale". Inoltre, hà dimustratu chì u 18% di tutta a pupulazione di i Stati Uniti puderia esse identificata solu avendu accessu à un set di dati chì cuntene informazioni nantu à u (1) paese d'origine, (2) sessu è (3) data di nascita. Pensate à e fonti publiche sopra menzionate, cum'è Facebook, LinkedIn o Instagram. Hè visibile u vostru paese, sessu è data di nascita, o sò altri utilizatori capaci di deduce lu?

Illustrazione 3

I risultati di Sweeney

| Quasi-identificatori | % identificatu unicamente di a populazione di i Stati Uniti (248 milioni) |

| ZIP à 5 cifre, sessu, data di nascita | 87% |

| postu, sessu, data di nascita | 53% |

| paese, sessu, data di nascita | 18% |

Questu esempiu dimostra chì pò esse notevolmente faciule di anonimizà l'individui in dati apparentemente anonimi. Prima, stu studiu indica una grande magnitudine di risicu, cum'è U 87% di a pupulazione di i Stati Uniti pò esse facilmente identificata aduprendu poche caratteristiche. Siconda, i dati medichi esposti in stu studiu eranu assai sensibili. Esempii di dati di l'individui esposti da u dataset di visite in ospedale includenu etnicità, diagnosi è medicazione. Attributi chì si pò piuttostu tene secreti, per esempiu, da e cumpagnie d'assicuranza.

3) Individui infurmati

Un altru risicu di rimuovere solu identificatori diretti, cum'è i nomi, nasce quandu l'individui informati anu una cunniscenza superiore o informazioni nantu à tratti o cumpurtamentu di individui specifici in u dataset. Basatu nantu à a so cunniscenza, l'attaccante pò esse in gradu di ligà registri dati specifici à e persone reali.

Casu studiu

Un esempiu di attaccu à un set di dati aduprendu cunniscenze superiori hè u casu di taxi di New York, induve Atockar (2014) hà sappiutu smascà individui specifici. U dataset impiegatu cuntene tutti i viaghji in taxi in New York, arricchitu cù attributi di basa cum'è coordinate di partenza, coordinate di fine, prezzu è punta di a corsa.

Un individuu informatu chì sà chì New York hà sappiutu uttene viaghji in taxi à u club adultu 'Hustler'. Filtrendu u "locu finale", hà deduttu l'indirizzi esatti di partenza è cusì hà identificatu vari visitatori frequenti. Similmente, si puderia deduce viaghjate in taxi quandu l'indirizzu di casa di l'individuu era cunnisciutu. U tempu è u locu di parechje stelle di film di celebrità sò stati scuperti nantu à i siti di pettegolezzi. Dopu avè ligatu queste informazioni à i dati di i taxi di New York, era faciule di uttene i so viaghji in taxi, a quantità chì anu pagatu, è sì avianu manghjatu.

Illustrazione 4

Un individuu infurmatu

drop-off coordina Hustler

Bradley Cooper

Jessica Alba

4) Dati cum'è impronta digitale

Una linea cumuna di argumentazione hè "questi dati ùn valenu nunda" o "nimu ùn pò fà nunda cù questi dati". Questu hè spessu un sbagliu. Ancu i dati i più innocenti ponu formà una "impronta digitale" unica è esse aduprati per ridentificà l'individui. Hè u risicu derivatu da a crede chì i dati stessi ùn valenu nunda, mentre ùn hè micca.

U risicu di identificazione aumenterà cù l'aumentu di dati, AI, è altri strumenti è algoritmi chì permettenu a scoperta di relazioni cumplesse in i dati. Di conseguenza, ancu se u vostru set di dati ùn pò esse scupertu avà, è hè presumibilmente inutile per e persone non autorizate oghje, pò esse micca dumane.

Casu studiu

Un grande esempiu hè u casu induve Netflix hà destinatu à culligà u so dipartimentu R&D introducendu un cuncorsu apertu Netflix per migliurà u so sistema di raccomandazione di film. 'Quellu chì migliora l'algoritmu di filtrazione cullaburativa per prevede i valutazioni di l'utilizatori per i filmi vince un premiu di US $ 1,000,000'. Per supportà a folla, Netflix hà publicatu un set di dati chì cuntene solu l'attributi di basa seguenti: userID, filmu, data di gradu è gradu (dunque micca più infurmazioni nantu à l'utilizatore o filmu stessu).

Illustrazione 5

Struttura Dataset prezzu Netflix

| UserID | Movie | Data di gradu | Grade |

| 123456789 | Missione impussibile | 10-12-2008 | 4 |

In isolamentu, i dati parevanu inutili. Quandu si dumanda a dumanda "Ci hè una infurmazione di u cliente in u settore di dati chì deve esse mantenuta privata?", A risposta hè stata:

'Innò, tutte l'infurmazioni d'identificazione di i clienti sò state rimosse; tuttu ciò chì ferma sò valutazioni è date. Questu segue a nostra pulitica di privacy ... '

Tuttavia, Narayanan (2008) di l'Università di Texas in Austin hà dimustratu altrimente. A cumbinazione di gradi, data di graduazione è filmu di un individuu forma una impronta digitale unica. Pensate à u vostru cumpurtamentu Netflix. Quante persone pensate chì anu vistu u listessu inseme di filmi? Quanti anu vistu u listessu inseme di filmi in listessu tempu?

Dumanda principale, cumu currisponde à sta impronta digitale? Era piuttostu simplice. Basatu nantu à l'infurmazioni da u famosu situ web di classificazione di film IMDb (Internet Movie Database), una impronta digitale simile puderia esse furmata. Di cunsiguenza, l'individui puderia esse riidentificatu.

Mentre u comportamentu di guardà u filmu ùn pò micca esse presumitu cum'è informazioni sensibili, pensate à u vostru propiu comportamentu - vi dispiacerebbe se diventassi publicu? Esempii chì Narayanan hà furnitu in a so carta sò preferenze pulitiche (valutazioni nantu à "Ghjesù di Nazaretta" è "U Vangelu di Ghjuvanni") è preferenze sessuale (valutazioni nantu à "Bent" è "Queer as folk") chì ponu esse facilmente distillati.

5) Regulamentu Generale di Prutezzione di i Dati (GDPR)

GDPR puderia micca esse super-eccitante, nè a pallottula d'argentu trà l'argumenti di blog. Eppuru, hè utile uttene e definizioni dritte quandu trattanu dati persunali. Siccomu stu blog tratta di l'errore cuncepimentu cumunu di eliminà e colonne cum'è un modu per anonimizà i dati è per educàvi cum'è processatore di dati, cuminciamu cun esplorà a definizione di anonimizazione secondu u GDPR.

Sicondu u recital 26 da u GDPR, l'informazione anonimizzata hè definita cum'è:

"infurmazione chì ùn si riferisce micca à una persona fisica identificata o identificabile o dati persunali resi anonimi in tale modu chì u sughjettu di dati ùn hè micca o ùn hè più identificabile."

Postu chì unu prucessa i dati persunali chì si riferenu à una persona fisica, solu a parte 2 di a definizione hè pertinente. Per rispettà a definizione, ci vole à assicurà chì u sughjettu di dati (individuale) ùn sia o ùn sia più identificabile. Cum'è indicatu in questu blog, tuttavia, hè notevolmente semplice identificà l'individui basatu annantu à pochi attributi. Dunque, toglie i nomi da un inseme di dati ùn rispetta micca a definizione GDPR di anonimizazione.

in cunclusioni

Avemu sfidatu unu cumunemente cunsideratu è, purtroppu, sempre spessu applicatu approcciu di anonimizazione di dati: eliminazione di nomi. In u ghjocu Guess Who è quattru altri esempi nantu à:

- Attacchi di ligami

- Individui infurmati

- Dati cum'è una impronta digitale

- Regulazione Generale di Proteczione di Data (GDPR)

hè statu dimustratu chì a rimozione di i nomi fiasca cum'è anonimizazione. Ancu se l'esempii sò casi impressiunanti, ognunu mostra a simplicità di reidentificazione è l'impattu negativu potenziale nantu à a privacy di l'individui.

In cunclusione, a rimozione di nomi da u vostru dataset ùn dà micca risultati anonimi. Dunque, hè megliu evità di aduprà entrambi i termini in modu intercambiabile. Speru sinceramente chì ùn applicate micca questu approcciu per l'anonimizazione. E, se fate sempre, assicuratevi chì voi è a vostra squadra capisciate pienamente i rischi per a privacy, è sia permessi di accettà questi rischi per nome di e persone interessate.

I dati sò sintetici, ma a nostra squadra hè vera!

Cuntattate Syntho è unu di i nostri esperti entrerà in cuntattu cun voi à a velocità di a luce per esplorà u valore di i dati sintetici!

- D. Reinsel, J. Gantz, John Rydning. A Digitalizazione di u Mondu Da Edge à Core, Data Age 2025, 2018

- L. Sweeney. k-anonimatu: un mudellu per prutege a privacy. Revista Internaziunale di Incertezza, Fuzziness è Sistemi Basati nantu à a Cunniscenza, 10 (5), 2002: 557-570

- L. Sweeney. A Demografia Semplice Identifica Spessu Persone Unicamente. Università Carnegie Mellon, Documentu di travagliu nantu à a prutezzione di i dati 3. Pittsburgh 2000

- P. Samarati. Prutegge l'identità di i rispondenti in a liberazione di microdati. Transazzioni IEEE nantu à Ingegneria di Cunniscenza è Dati, 13 (6), 2001: 1010-1027

- Atockar. Riding with the Stars: Privacy di i passeggeri in u New York Taxicab Dataset, 2014

- Narayanan, A., & Shmatikov, V. (2008). De-anonimizazione robusta di grandi inseme di dati sparsi. In Proceedings - Simposium IEEE 2008 per a Sicurezza è a Privacy, SP (pp. 111-125)

- Regolamentu Generale di Prutezzione di i Dati (GDPR), Recital 26, Micca Applicabile à i Dati Anonimi